Tabla de contenidos

En febrero tenía 98 artículos publicados, cuatro años sin tocar el blog, y cero ganas de pasarme semanas leyendo posts de 2015 para decidir qué hacer con ellos.

Resultado dos meses después: 36 artículos eliminados con sus redirects, 8 piezas nuevas o reescritas con investigación real, Lighthouse 100/100, y el blog funcionando sobre una arquitectura limpia. Una persona. Sin agencia. Sin equipo de contenidos.

No llegué aquí de golpe. Pasé meses usando la IA exactamente como la usa todo el mundo — abriendo chats, copiando respuestas, sintiéndome productivo sin serlo del todo. Este artículo es sobre lo que cambió cuando dejé de usar la IA como herramienta y empecé a usarla como infraestructura.

98 posts auditados, clasificados y priorizados. 36 eliminados. 8 artículos reescritos o nuevos. Todo gestionado con agentes de IA. tecnicaseo.com — febrero-marzo 2026

Por qué esto te importa si contratas o haces SEO

Antes de entrar en el cómo, una pregunta que rara vez se hace al contratar un consultor SEO: ¿usa la IA como chat o como infraestructura?

No es un detalle técnico. Es la diferencia entre alguien cuyo output está limitado por sus horas, y alguien cuyos sistemas multiplican lo que produce en cada una de ellas.

Un consultor con sistemas puede auditar 98 posts en una sesión, producir artículos con investigación verificada, y mantener la coherencia editorial artículo tras artículo, porque las reglas están documentadas y el sistema las sigue. El mismo presupuesto. Resultado radicalmente diferente.

El problema: usar IA sin contexto de proyecto

Busca “IA para SEO” en Google. Vas a encontrar dos cosas: listas de herramientas SaaS y guías de prompts para meta descriptions.

Es contenido útil para empezar. El problema es que se queda en la superficie — sabes qué herramienta existe, pero no cómo integrarlo en un flujo de trabajo real. Es como tener una calculadora potente sin saber qué cuentas hacer con ella.

Después de meses probando distintas formas de trabajar con IA, veo tres niveles muy claros:

Nivel 1: El chat. Abres ChatGPT, pides algo, copias y pegas. “Dame 10 ideas de keywords para una clínica dental.” Útil para tareas puntuales, pero el flujo sigue siendo manual y el resultado depende enteramente de tu prompt. El LLM no sabe nada de tu proyecto.

Nivel 2: El terminal. Encadenar comandos con LLMs: curl para sacar datos, jq para procesarlos, un LLM para enriquecerlos. Es potente, pero sigue siendo prompt → respuesta. Sin contexto de proyecto, sin memoria, sin estado.

Nivel 3: La infraestructura. Un agente que arranca leyendo tu proyecto completo — estructura de archivos, código, reglas editoriales, inventario de contenido, historial de cambios — y con ese contexto ejecuta tareas complejas de principio a fin. No comandos sueltos. Resultados.

El salto del nivel 2 al 3 no es técnico. Es de mentalidad. No es “qué comando ejecuto” sino “qué decisiones delego.”

Y los niveles 1 y 2 son perfectamente válidos para lo que son. Lo que cambia en el nivel 3 es la escala de lo que puedes producir solo.

Qué significa usar IA como infraestructura

No significa automatizar todo. Significa tener un sistema donde la IA opera con suficiente contexto como para producir trabajo de calidad sin que tengas que explicarle todo desde cero cada vez.

En la práctica, esto se traduce en que la IA:

- Lee y entiende tu proyecto completo — no un archivo, no un prompt: tu codebase, tu historial, tu configuración.

- Toma decisiones basadas en reglas que tú defines — tono de voz, estructura visual, vocabulario, protocolos de publicación.

- Ejecuta cambios coordinados — no un párrafo suelto, sino un artículo completo con sus internal links, su frontmatter, sus imágenes optimizadas, y su entrada en el changelog.

- Mantiene estado — sabe qué se hizo la última sesión, qué queda pendiente, qué artículos necesitan rewrite y en qué orden.

Para que se vea la diferencia concreta:

Nivel 1: Abres ChatGPT y escribes “Reescribe este artículo sobre migración HTTPS para 2026.” Te devuelve un texto razonable. Lo pegas en tu CMS.

Nivel 3: El agente arranca leyendo el brief del artículo — objetivo, audiencia, análisis competitivo, keywords mapeadas a secciones, outline completo. Lee el design system con las reglas de tono. Lee las writing rules con lecciones de artículos anteriores. Lee el artículo original para saber qué conservar. Lee los artículos relacionados para planificar internal links. Y produce un .mdx listo para revisión — con frontmatter correcto, bloques visuales, fuentes como notas al pie, y ritmo visual verificado.

La diferencia no es que el resultado esté “mejor escrito.” Es que es coherente con todo lo que has publicado antes. Sigue las mismas reglas, usa el mismo tono, respeta la misma estructura. Es parte de un sistema, no una pieza suelta.

Un prompt produce una respuesta. Un agente produce un resultado.

Caso real: cómo gestiono tecnicaseo.com con IA

En resumen: Auditoría de 98 posts con datos de GSC, pipeline editorial de 12 secciones por artículo, gestión técnica del blog (migración, 404s, deploy), y un sistema de archivos que mantiene el estado del proyecto entre sesiones.

Esto no es teoría. Es lo que hago con este blog. El sistema por dentro.

Auditoría de contenido a escala

Cuando migré de WordPress a Astro heredé 98 posts. Cuatro años sin publicar, centrado en trabajo de clientes. La mayoría necesitaba intervención: artículos de 2015 con herramientas muertas, guest posts que no reflejaban mi voz actual, listados obsoletos.

El trabajo clásico: leer cada uno, decidir qué hacer, documentar. A mano, semanas.

Con el agente, el proceso fue:

- Rastrear los 98 posts cruzando con datos de GSC (impresiones, posición media, clics)

- Clasificar cada uno: OK, UPDATE, REWRITE, MERGE o DROP

- Estimar el potencial de tráfico si se mejorara cada post

- Documentar la decisión con su justificación

Resultado: 5 posts sin tocar, 11 con refresh ligero, 31 rewrites priorizados por potencial, 13 merges, y 36 eliminados con sus redirects 301.

36 artículos eliminados con redirect 301. 31 rewrites priorizados por potencial de tráfico. Una sesión.

Toda esa información vive en archivos dentro del repositorio — no en un Google Sheet, no en la cabeza de nadie. El agente puede leerla en cualquier sesión y saber exactamente dónde estamos.

Sistema editorial completo

Cada artículo que publico sigue el mismo pipeline:

Brief de 12 secciones — objetivo, audiencia, análisis competitivo de la SERP, social research (Reddit, X, YouTube), keywords mapeadas a secciones, outline con word targets, elementos requeridos, meta tags, señales E-E-A-T, estrategia de CTA.

Draft con contexto completo — el agente escribe con acceso al design system, las writing rules, y los artículos ya publicados para planificar internal links.

Revisión mía — siempre. La IA produce el borrador. Yo decido qué se publica.

El artículo sobre SEO para inteligencia artificial pasó por este proceso: 24 fuentes verificadas (más de 50 descartadas), 4 iteraciones de draft, 7.500 palabras donde cada dato tiene su fuente original comprobada. En un momento encontramos un dato de TollBit que circulaba como 42% en varias fuentes secundarias. Fuimos al PDF original y era 21,24% — la mitad. Ese tipo de comprobación es la que marca la diferencia entre contenido que cita y contenido que verifica.

Gestión técnica

El blog corre sobre Astro. La migración desde WordPress, la configuración de Netlify, las imágenes OG automáticas para 104 posts, la corrección de 160+ errores 404 detectados con Screaming Frog — todo gestionado desde el terminal con Claude Code.

Cuando digo “gestionado con IA” no me refiero a que le pedí que me hiciera una web. Me refiero a que le digo “corrige los 404s que encontró Screaming Frog”, y el agente lee el CSV, identifica los patrones, y configura los redirects correspondientes. En una sesión.

Lighthouse 100/100. Menos de 150KB por página. Cero JavaScript innecesario. tecnicaseo.com — rendimiento actual

El sistema operativo del proyecto

Lo que hace que todo esto funcione no es el agente — es el contexto que le das.

En la raíz de mi repositorio hay un archivo de instrucciones que funciona como el sistema operativo del proyecto: stack técnico, estructura de archivos, reglas de contenido, voz y tono, reglas de imágenes, performance budget, protocolo de publicación, protecciones de URLs.

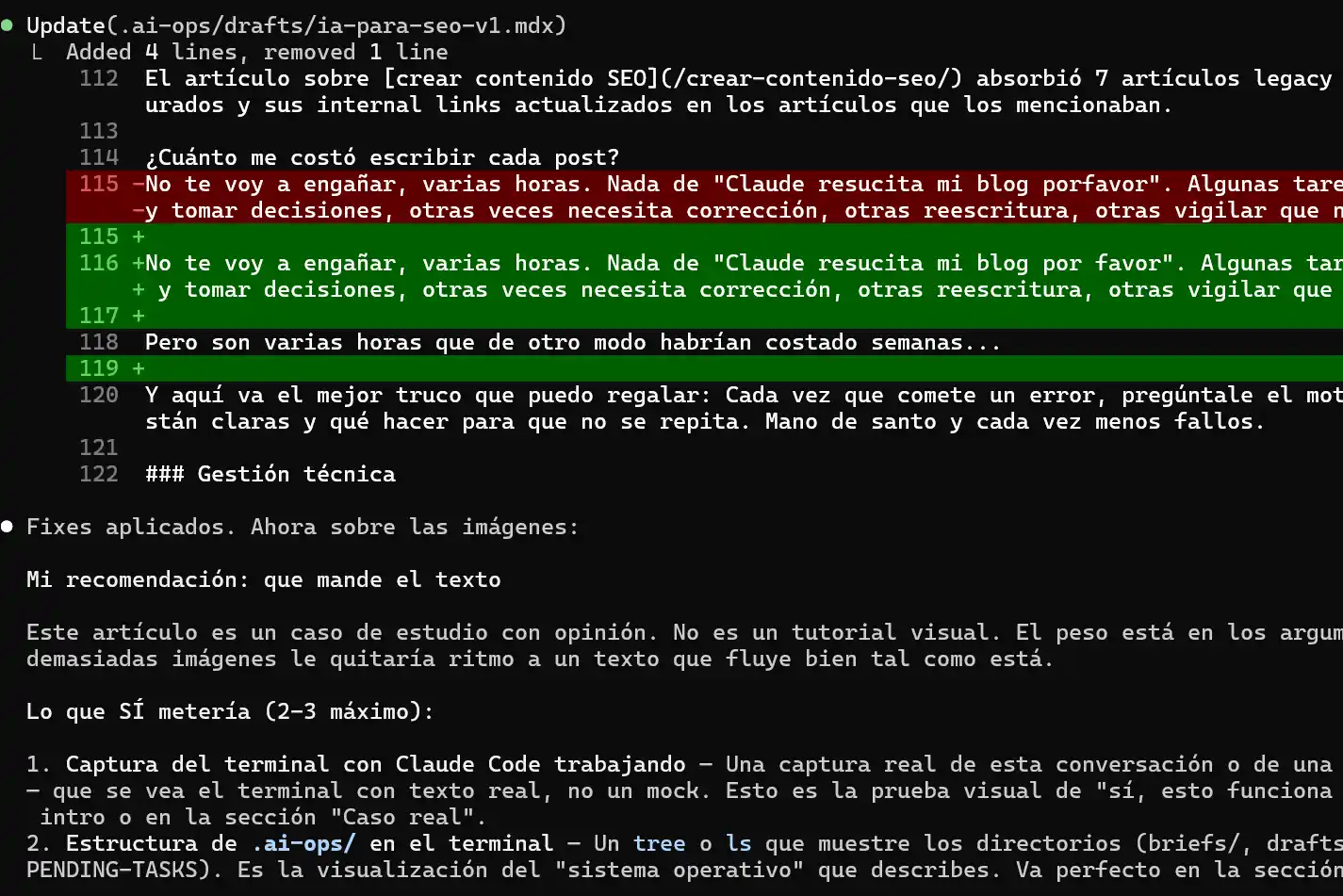

Y dentro del repo hay un directorio .ai-ops/ con:

- Briefs de cada artículo

- Drafts en desarrollo (nunca se toca un archivo en producción hasta que el draft está aprobado)

- Auditorías de contenido con el inventario maestro

- Workflows documentados y lecciones aprendidas

- CHANGELOG actualizado con cada sesión

- PENDING-TASKS como fuente de verdad del estado actual

Cada vez que el agente arranca una sesión nueva, lo primero que hace es leer el estado del proyecto. Sabe qué artículos están pendientes, cuál es la prioridad, qué se hizo la última vez. No empieza de cero.

Todo vive en el repositorio. Versionado con git. Al lado del código.

Lo que NO hago con IA (y por qué)

Esto es importante, porque es fácil dejarse llevar por el hype y asumir que la IA puede con todo. No puede. Y aprender dónde están los límites me costó tiempo.

No publico sin revisión humana. Ningún artículo pasa de draft: true a draft: false sin que yo lo lea entero. El agente produce borradores de alta calidad, pero la decisión de publicar es mía. Siempre.

No delego decisiones de negocio. Qué publicar, qué eliminar, qué priorizar, a quién enlazar — eso lo decido yo. El agente me da datos para decidir mejor, pero la decisión es mía.

No confío ciegamente en los datos que genera. Ya lo ves arriba con el caso TollBit. Si hay un dato importante, voy a la fuente original.

No uso IA para generar volumen. No publico 30 artículos al mes. Cada pieza pasa por el mismo proceso: brief, research, draft, revisión, publicación. Es más lento, pero es lo que posiciona a largo plazo.

Cualquier cambio que elimine una URL publicada requiere mi confirmación explícita. Esa regla está escrita en las instrucciones del proyecto. El agente lo sabe y pregunta antes de tocar. Una URL que desaparece sin redirect es tráfico perdido.

La IA amplifica lo que ya sabes. Si dominas el SEO, te convierte en un equipo de tres personas.

¿Cuánto tiempo lleva realmente?

Varias horas por artículo. No voy a pintarlo de otra forma.

Algunas tareas son manuales para dar más contexto. A veces el agente necesita corrección o reescritura parcial. Pero son varias horas que de otro modo habrían costado semanas, y la calidad del resultado es consistente de un artículo al siguiente.

Lo que más me ha ayudado a mejorar la eficiencia: cada vez que el agente comete un error, le pregunto el motivo y si las instrucciones están claras. Esa conversación alimenta las writing rules del proyecto. Cada sesión con menos fricciones que la anterior.

Cómo empezar si quieres montar algo similar

En resumen: Documenta cómo trabajas, dale contexto al agente (no solo prompts), monta un pipeline reproducible, y revisa siempre antes de publicar.

No necesitas Claude Code para empezar. Ni Cursor, ni ninguna herramienta específica. Lo que necesitas es un sistema. La herramienta viene después.

1. Documenta cómo trabajas. Si no tienes reglas escritas — tono, proceso, estructura, vocabulario — la IA no puede seguirlas. Escribe tu design system, aunque sea básico. Cómo hablas, qué estructura siguen tus artículos, qué vocabulario usas.

2. Dale contexto, no solo prompts. La diferencia entre un resultado mediocre y uno bueno rara vez está en el prompt. Está en cuánto sabe la IA de tu proyecto. Dale tu inventario de contenido, tus reglas editoriales, tu historial. Cuanto más contexto tiene, mejores decisiones toma.

3. Monta flujos reproducibles. Brief → Draft → Revisión → Publicación. Siempre igual. La consistencia del proceso es lo que produce la consistencia del resultado.

4. Revisión humana siempre. La IA produce el 80%. El 20% restante — criterio editorial, tono fino, decisiones de negocio, verificación de datos — es tuyo. Y ese 20% es lo que separa el contenido que posiciona del que no deja huella.

Si quieres dar el paso técnico: Claude Code CLI cuesta unos 20€ al mes y opera directamente sobre tu proyecto local. Pero la inversión real no es el software — es el tiempo de montar el sistema. Eso es lo que requiere pensar antes de producir.

Para terminar

La pregunta ya no es si la IA sirve para SEO. Eso está resuelto.

La pregunta es cómo la integras. Como chat para tareas puntuales, o como infraestructura que conoce tu proyecto, sigue tus reglas, y mantiene el estado entre sesiones.

Montar ese sistema lleva tiempo. Requiere documentar cómo trabajas antes de pedirle a la IA que lo haga contigo. Pero cuando está en marcha, la diferencia en lo que produces como persona sola es difícil de explicar sin mostrarlo.

Espero que este artículo lo haya mostrado un poco. Si tienes preguntas sobre alguna parte del sistema, las respondo en los comentarios.

Y si prefieres que alguien con estos sistemas ya montados trabaje en tu SEO, hablamos.